蘋果聯手OpenAI 保護私隱引熱議

馬斯克警告用戶數據或外洩 擬禁旗下公司使用蘋果設備

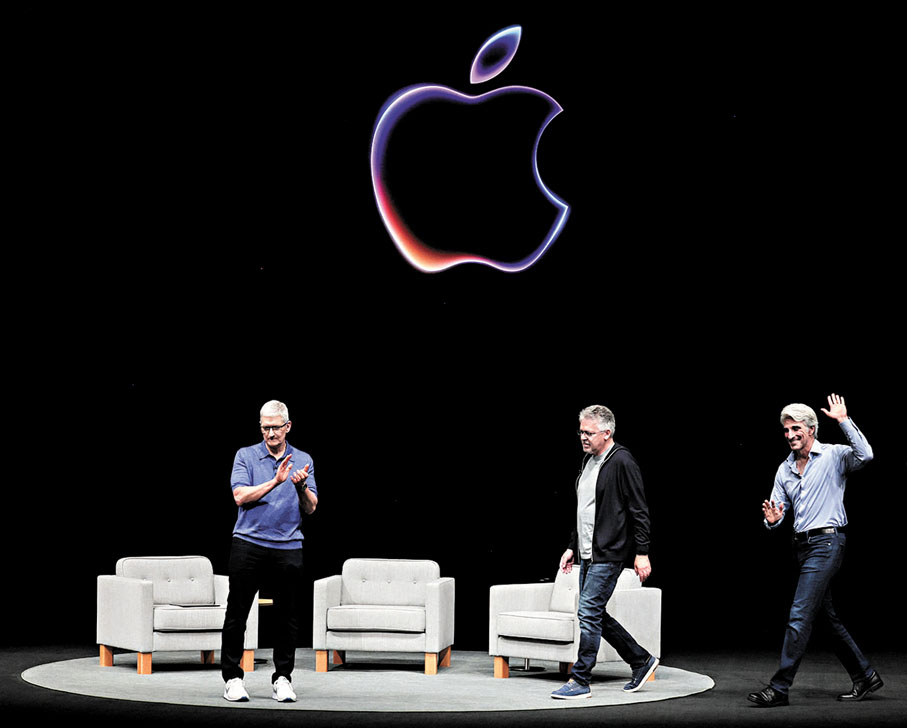

香港文匯報訊 美國蘋果公司周一(6月10日)舉行全球開發者大會,宣布與科企OpenAI合作,將人工智能(AI)聊天機械人ChatGPT引入蘋果的電子產品。但電動車企業Tesla行政總裁、同樣致力研發AI產品的馬斯克警告稱,該合作或導致蘋果用戶數據外洩,若將ChatGPT整合至蘋果作業系統,他便要禁止名下公司使用任何蘋果裝置,以免危及資料安全。分析相信保護用戶私隱,將是AI技術後續發展的重要議題。

今屆開發者大會上,最受外界關注的AI技術Apple Intelligence壓軸登場。蘋果表示,這款AI技術會整合至蘋果電子產品的各個系統,用戶可以在撰寫稿件、校對內容、日常生活時使用各類AI功能,發送短訊時還可以用文字生成圖片。蘋果還宣布與OpenAI合作後,用戶可以在喚起數碼助理Siri時,免費使用ChatGPT。

蘋果私有雲保護數據

向來倡導私隱保護的蘋果,今次宣布利用新技術私有雲(PCC)保護用戶數據,意味蘋果不會將用戶所有數據都傳送到雲端,而是僅上傳用戶查詢時所需要的基本數據。負責收集用戶數據的蘋果雲端服務器,則不設永久儲存能力,蘋果用戶透過設備發送到ChatGPT的所有內容,都不會被長期保存。加上蘋果沒有為PCC設置繞開私隱保護通道的特權接口,黑客必須攻破整個PCC系統的防火牆,才能嘗試尋找特定使用者的資料。

不過馬斯克指出,現有的數據分享用戶條款及協議非常複雜,用戶很可能在無意間,同意分享了自己的私隱數據。他亦質疑OpenAI可能利用蘋果用戶這一巨大資料庫獲利,「蘋果無法自主研發AI,卻稱能確保OpenAI保護用戶私隱,這是荒謬的。」

訪客亦需交出設備

馬斯克又稱,他會規定日後進入其名下公司的訪客,必須將蘋果設備交出,放在屏蔽訊號的法拉第籠(Faraday cage)當中,暗指他警惕蘋果設備有洩密風險。

美國科技網站VentureBeat專欄作家、硅谷私隱安全分析師托馬森指出,PCC並非萬無一失,一旦其加密演算法的弱點暴露,不論是內部破壞還是外部攻擊,攻破PCC防火牆的風險都很高。托馬森也強調,私隱外洩最大的風險正是設備本身,例如黑客可以冒用受害人身份使用PCC,或是利用釣魚軟件等方式,令用戶在無意間落入私隱外洩陷阱。

托馬森認為,在AI時代保護用戶私隱,既需要先進的技術,也需要不斷彌補電子設備作業系統、應用程式和網絡協定中的潛在漏洞,「PCC是發展AI技術與保護私隱共存的美好願景,但人們需要從根本上改變處理個人資料的方式,以及確定處理敏感資訊人員的責任。」

AI時代加強私隱保護方法

勿與聊天機械人分享敏感數據

使用ChatGPT等AI軟件時,盡量避開涉及個人私隱和敏感數據的議題,例如向其詢問如何設置密碼、討論自身或他人的健康情況,甚至用於起草工作中的機密文件等。

謹慎在網上公開內容

網絡用戶在網上撰寫的文字、社媒分享的圖片,各類影片和語音筆記,都可能被利用。例如利用公開的影像和音頻,AI軟件可以模擬特定對象的聲音或容貌,用戶過多分享類似的個人資料,會增加身份被盜用的風險。

小心處理網絡活動

AI演算法可以整合並且分析用戶的動向,需要用戶留意,例如用戶在與AI聊天機械人溝通時,傳遞出負面情緒,部分AI軟件可能會因此放大傳送給用戶的負面信息。

盡可能保持匿名

AI系統可能透過用戶在網上留下的少量數據,整合出準確的個人資料,或進行完善的性格分析等。匿名使用網絡可以一定程度減少個人資料外洩風險,相關方法包括使用匿名網絡瀏覽器、使用不同的賬號名稱,嘗試一次性電郵等。

使用更複雜密碼

部分AI軟件可用於破譯密碼,例如一款名為PassGAN的軟件,會使用從外洩的資料庫中獲取的數百萬個真實密碼,進行破譯密碼訓練。用戶在不同的網站開設賬號時,可以使用不同的密碼,也可設置更長的密碼加大破解難度。

常閱讀私隱政策

使用網絡服務、分享任何類型的個人資料前,用戶應留意閱讀私隱政策,了解相關企業、網站和平台會如何處理公開的資料。若條款和政策對用戶保護私隱不利,用戶應設法避免使用相關服務,或盡可能避免公開分享自己的資料。