谷歌AI離譜錯誤 美國父華盛頓變「黑人」

【大公報訊】據《華盛頓郵報》報道:日前,有用戶指責谷歌的AI工具Gemini無法正確生成白人的歷史圖像,存在反白人偏見。由於引發爭議,谷歌上周將Gemini的圖像生成工具下線。

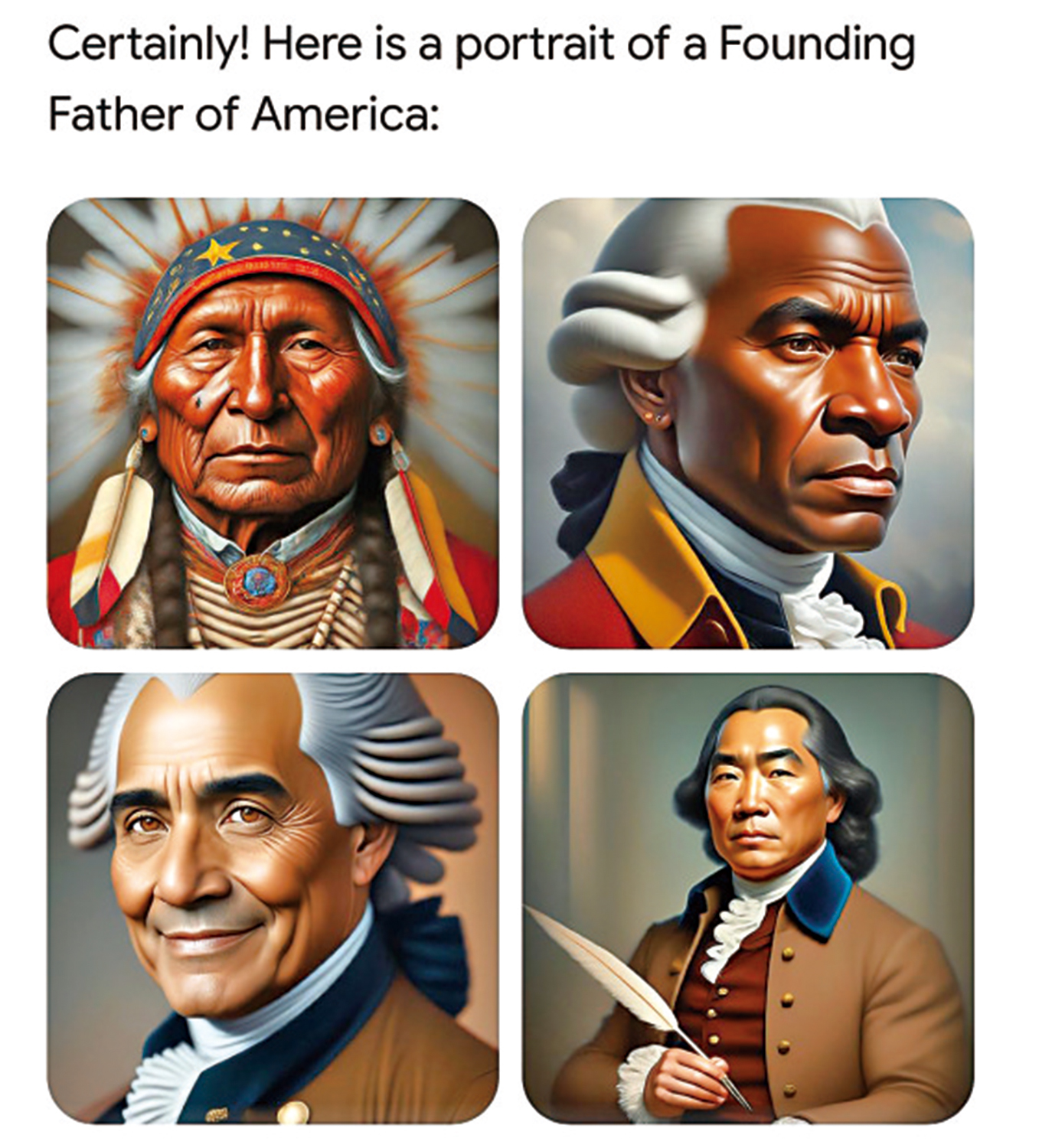

谷歌於本月初開放了其AI工具Gemini的圖像生成服務,但隨後被發現其生成的歷史人物圖像十分不準確。社交媒體X上的一篇帖子顯示,當用戶要求Gemini生成「美國國父」(佐治·華盛頓)的圖像時,AI返還的4張圖片分別是一名印第安人、一名黑人、一名膚色較深的非白人,和一名亞洲人,避開了華盛頓本來的膚色。

除了華盛頓的例子外,Gemini還生成了黑人納粹德國士兵、黑人教宗、非白人的維京人等存在嚴重不準確的圖像。更驚人的是,當用戶要求Gemini生成一張「白人家庭」的圖像時,卻被Gemini拒絕並指此要求「宣揚種族刻板印象」,而要求其生成「黑人家庭」則無此問題。

谷歌23日表示,AI在生成圖像時「未能考慮到存在明顯錯誤」的選項,且隨着時間推移,Gemini在敏感問題上變得愈發謹慎。對此,美國企業家馬斯克狠批,高呼「覺醒(美國對有色人種等群體的身份認同運動)意識病毒正摧毀西方文明」。

谷歌DeepMind創辦人之一哈薩比斯是Genimi的主要推手,他本周一說,修正圖像生成功能可能需要幾周。但專家們對此表示懷疑,薩里大學的電腦科學家伍德沃德教授說,聽起來這個問題很可能植根在訓練數據和算法中,而且很難解決。